- 话题

37834 热度

18832 热度

42482 热度

44734 热度

16290 热度

18974 热度

6524 热度

3277 热度

96938 热度

- 10我的Gate时刻

28253 热度

- 置顶

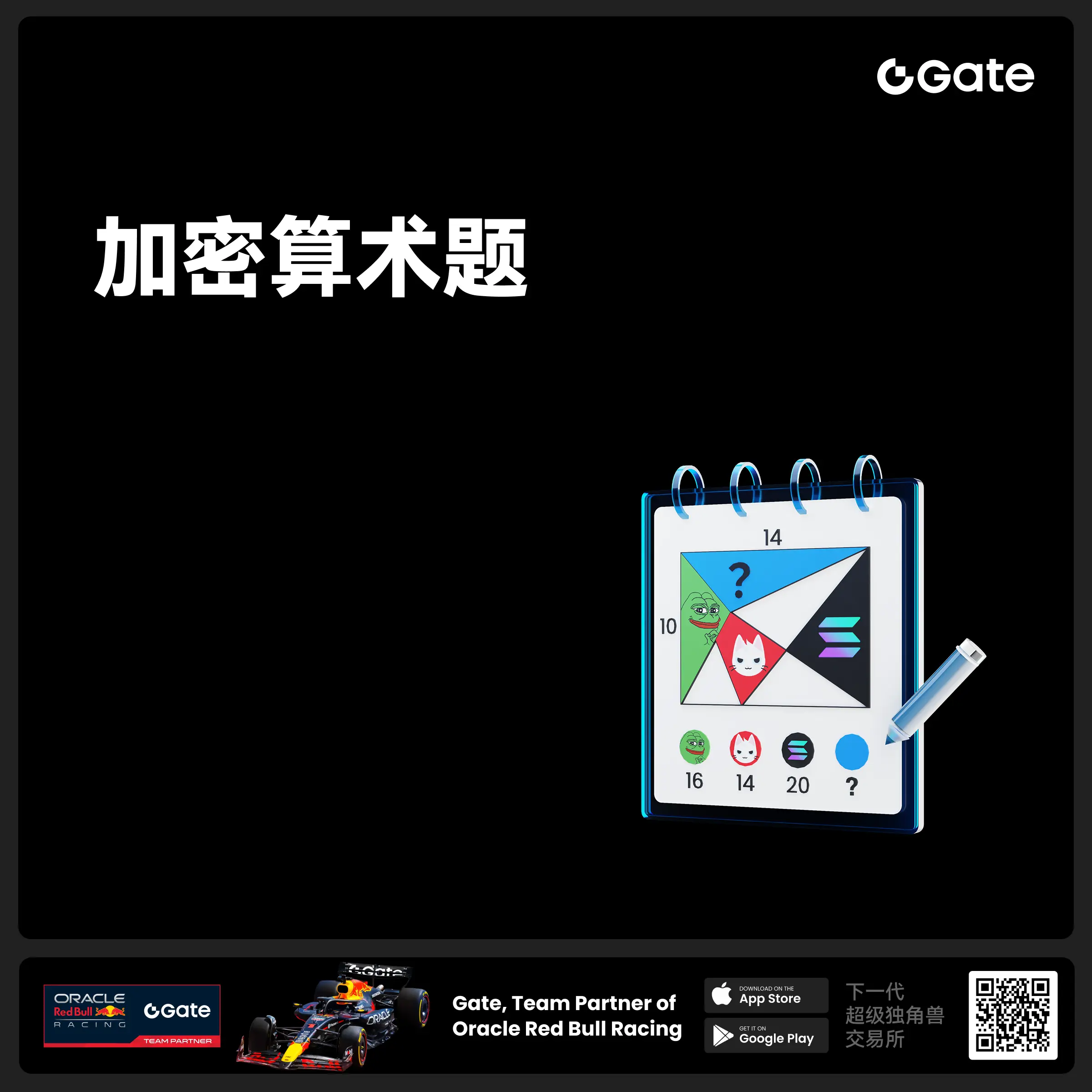

- 🧠 #GateGiveaway# - 加密算术题挑战!

你能解出这道加密题吗?

💰 $10 合约体验券 * 4 位获奖者

参与方式:

1️⃣ 关注 Gate广场_Official

2️⃣ 点赞此条动态贴文

3️⃣ 在评论中留下你的答案

📅 截止时间:7 月 22 日 12:00(UTC+8)

- 📢 ETH冲击4800?我有话说!快来“Gate广场”秀操作,0.1 ETH大奖等你拿!

牛市预言家,可能下一个就是你!想让你的观点成为广场热搜、赢下ETH大奖?现在就是机会!

💰️ 广场5位优质发帖用户+X浏览量前5发帖用户,瓜分0.1 ETH!

🎮 活动怎么玩,0门槛瓜分ETH!

1.话题不服来辩!

带 #ETH冲击4800# 和 #ETH# 在 广场 或 K线ETH下 围绕一下主题展开讨论:

-ETH是否有望突破4800?

-你看好ETH的原因是什么?

-你的ETH持仓策略是?

-ETH能否引领下一轮牛市?

2. X平台同步嗨

在X平台发帖讨论,记得带 #GateSquare# 和 #ETH冲击4800# 标签!

把你X返链接提交以下表单以瓜分大奖:https://www.gate.com/questionnaire/6896

✨发帖要求:

-内容须原创,字数不少于100字,且带活动指定标签

-配图、行情截图、分析看法加分,图文并茂更易精选

-禁止AI写手和灌水刷屏,一旦发现取消奖励资格

-观点鲜明、逻辑清晰,越有料越好!

关注ETH风向,创造观点价值,从广场发帖开始!下一个牛市“预言家”,可能就是你!🦾🏆

⏰ 活动时间:2025年7月18日 16:00 - 2025年7月28日 23:59(UTC+8)

【立即发帖】 展现你的真知灼见,赢取属于你的ETH大奖!

- 🎉 #Gate Alpha 第三届积分狂欢节 & ES Launchpool# 联合推广任务上线!

本次活动总奖池:1,250 枚 ES

任务目标:推广 Eclipse($ES)Launchpool 和 Alpha 第11期 $ES 专场

📄 详情参考:

Launchpool 公告:https://www.gate.com/zh/announcements/article/46134

Alpha 第11期公告:https://www.gate.com/zh/announcements/article/46137

🧩【任务内容】

请围绕 Launchpool 和 Alpha 第11期 活动进行内容创作,并晒出参与截图。

📸【参与方式】

1️⃣ 带上Tag #Gate Alpha 第三届积分狂欢节 & ES Launchpool# 发帖

2️⃣ 晒出以下任一截图:

Launchpool 质押截图(BTC / ETH / ES)

Alpha 交易页面截图(交易 ES)

3️⃣ 发布图文内容,可参考以下方向(≥60字):

简介 ES/Eclipse 项目亮点、代币机制等基本信息

分享你对 ES 项目的观点、前景判断、挖矿体验等

分析 Launchpool 挖矿 或 Alpha 积分玩法的策略和收益对比

🎁【奖励说明】

评选内容质量最优的 10 位 Launchpool/Gate - 和其他领域不一样的是:你想支持一个 Web3 游戏项目,你必须要「双投」——既要投时间,也要投钱。

- 🎉【Gate 3000万纪念】晒出我的Gate时刻,解锁限量好礼!

Gate用户突破3000万!这不仅是数字,更是我们共同的故事。

还记得第一次开通账号的激动,抢购成功的喜悦,或陪伴你的Gate周边吗?

📸 参与 #我的Gate时刻# ,在Gate广场晒出你的故事,一起见证下一个3000万!

✅ 参与方式:

1️⃣ 带话题 #我的Gate时刻# ,发布包含Gate元素的照片或视频

2️⃣ 搭配你的Gate故事、祝福或感言更佳

3️⃣ 分享至Twitter(X)可参与浏览量前10额外奖励

推特回链请填表单:https://www.gate.com/questionnaire/6872

🎁 独家奖励:

🏆 创意大奖(3名):Gate × F1红牛联名赛车模型一辆

👕 共创纪念奖(10名): 国际米兰同款球员卫衣

🥇 参与奖(50名):Gate 品牌抱枕

📣 分享奖(10名):Twitter前10浏览量,送Gate × 国米小夜灯!

*海外用户红牛联名赛车折合为 $200 合约体验券,国米同款球衣折合为 $50 合约体验券,国米小夜灯折合为 $30 合约体验券,品牌抱枕折合为 $20 合约体验券发放

🧠 创意提示:不限元素内容风格,晒图带有如Gate logo、Gate色彩、周边产品、GT图案、活动纪念品、活动现场图等均可参与!

活动截止于7月25日 24:00 UTC+8

3

GPT模型可信度评估揭示多维度潜在风险

生成式预训练模型可信度评估结果揭示潜在风险

近期,一个由多所知名高校和研究机构联合组建的研究团队发布了一项针对大型语言模型(LLMs)可信度的综合评估结果。该评估聚焦于GPT系列模型,通过多个维度对其可信度进行了全面分析。

研究发现了一些此前未公开的与可信度相关的漏洞。例如,GPT模型容易受误导产生有害和带有偏见的输出,还可能泄露训练数据和对话历史中的隐私信息。有趣的是,尽管GPT-4在标准测试中通常比GPT-3.5更可靠,但在面对恶意设计的提示时反而更容易受到攻击,这可能是由于GPT-4更严格地遵循了误导性指令。

评估从8个角度对GPT模型进行了全面检验,包括对抗性鲁棒性、有毒性和偏见、隐私保护等方面。研究人员构建了多种评估场景,使用不同的任务描述、系统提示和数据集来测试模型的表现。

在对抗性鲁棒性方面,研究发现GPT模型对某些文本攻击较为脆弱。在有毒性和偏见方面,模型在一般情况下表现尚可,但在误导性提示下容易输出有偏见的内容,且偏见程度因人群和主题而异。在隐私保护方面,模型可能会泄露训练数据中的敏感信息,尤其是在特定提示下。

总的来说,这项研究揭示了GPT模型在可信度方面存在的一些潜在风险,为后续改进提供了方向。研究团队希望这一评估框架能推动业界共同努力,开发出更安全可靠的语言模型。